Interpretierbarkeit maschineller Lernverfahren in der Kreditrisikomessung

Methoden zur Erklärbarkeit von ML-Modellen im aufsichtsrechtlichen Kontext der Kreditrisikomessung – von SHAP bis XAI-Frameworks.

Autoren: Prof. Dr. Dirk Schieborn, Prof. Dr. Volker Reichenberger

Journal: Zeitschrift für das gesamte Kreditwesen

Erscheinungsjahr: 2021

Zusammenfassung

Maschinelle Lernverfahren liefern in der Kreditrisikomessung oft bessere Prognosegüten als klassische statistische Modelle – sind aber in ihrer Funktionsweise schwerer nachvollziehbar. Dies stellt Banken vor eine grundlegende Herausforderung: Aufsichtsbehörden erwarten, dass Ratingverfahren erklärbar und validierbar sind.

Der Artikel systematisiert die gängigen Ansätze zur Interpretierbarkeit (Explainable AI / XAI) und bewertet sie hinsichtlich ihrer Praxistauglichkeit für IRBA-Ratingverfahren. Im Fokus stehen:

- Modellbasierte Interpretierbarkeit: Entscheidungsbäume, lineare Modelle mit Regularisierung

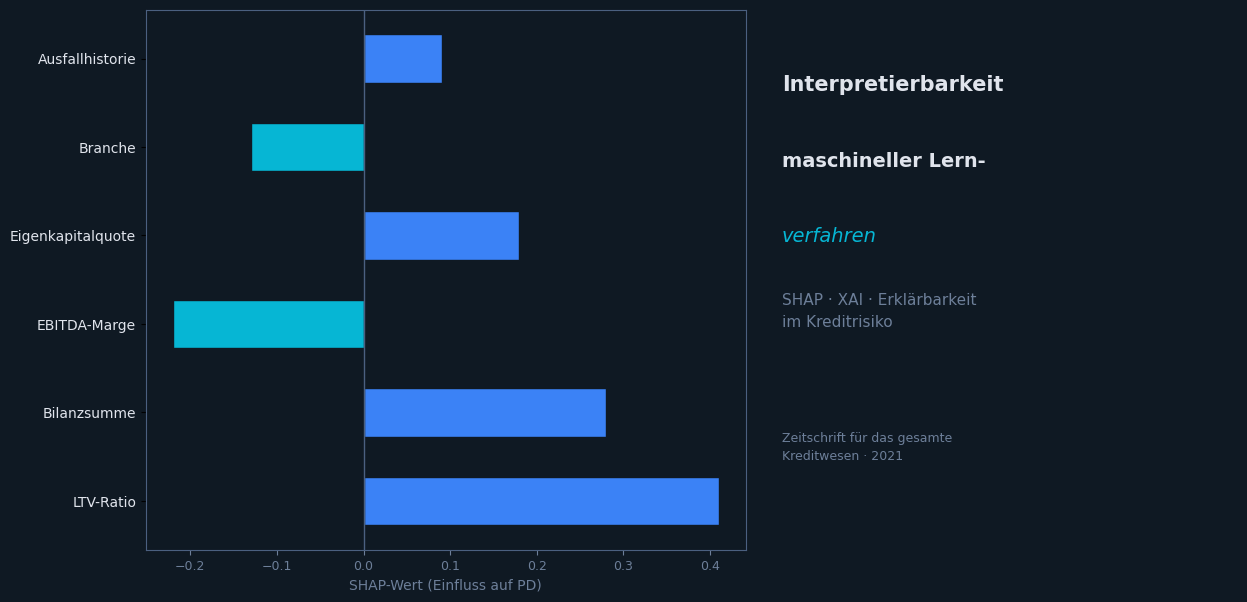

- Post-hoc-Erklärbarkeit: SHAP (SHapley Additive exPlanations), LIME

- Regulatorische Anforderungen: EBA-Leitlinien, MaRisk, CRR-Dokumentationspflichten

Fazit

Eine sorgfältig gewählte Kombination aus leistungsfähigen ML-Verfahren und geeigneten Erklärbarkeitsmethoden ermöglicht es Banken, das Potenzial der Künstlichen Intelligenz im Risikomanagement auszuschöpfen – ohne dabei aufsichtsrechtliche Anforderungen zu gefährden.